왜 갑자기 난리인가

지난달 말에 알리바바 통이랩에서 Z-Image라는 모델을 공개했는데, 커뮤니티 반응이 좀 이상해요. 보통 새 모델 나오면 “그냥 그렇네” 하고 넘어가는 경우가 많거든요. 근데 이건 트위터랑 레딧에서 계속 언급이 되고 있어요.

크기는 작은데 결과물이 이상하다

플럭스가 120억 파라미터, SDXL이 35억이에요. Z-Image는 60억. 중간쯤 되는 크기인데, 결과물 보면 플럭스랑 거의 비슷하거나 오히려 나은 경우도 있어요. 특히 피부 표현이나 머리카락 디테일 쪽에서요. 이게 말이 되나 싶었는데, 아키텍처를 뜯어보니까 이유가 있더라고요.

구조 자체가 다르다

기존 모델들은 텍스트랑 이미지를 따로 처리하다가 중간에 합쳐요. Z-Image는 그냥 처음부터 한 줄로 이어붙여서 통째로 처리해요. S3-DiT라고 부르는 방식인데, 중간에 정보 교환하는 과정에서 생기던 노이즈가 줄어든대요. 기술 문서 보면 이것저것 써 있는데, 핵심은 그거예요.

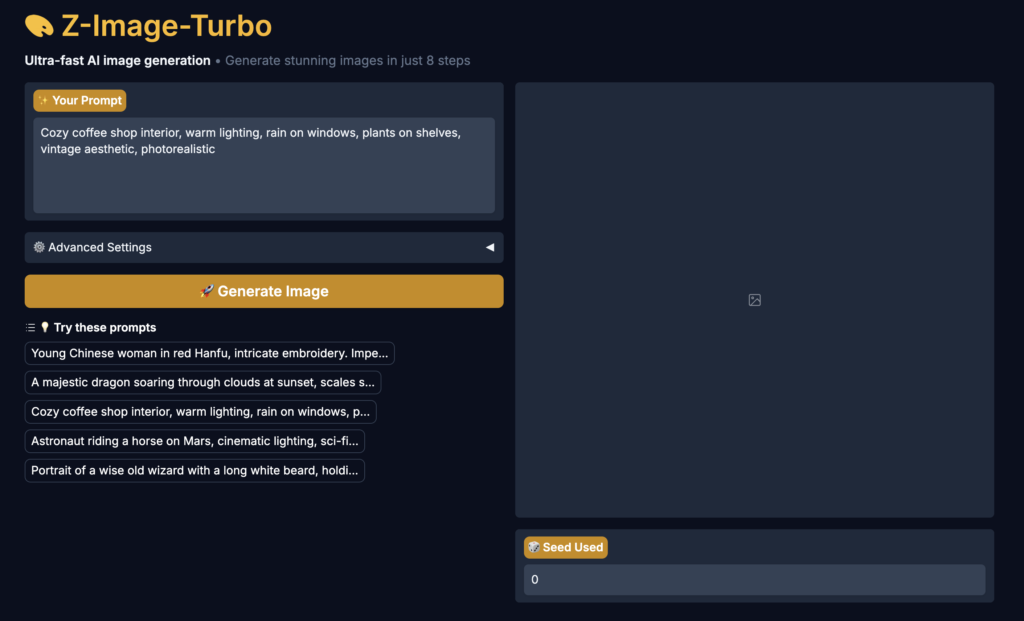

8스텝이면 끝난다

속도가 진짜 빨라요. SDXL 쓸 때 30스텝에 1분 넘게 기다렸거든요. Z-Image는 8스텝이면 됩니다. 서버급 장비에서는 1초도 안 걸리고, 4060 같은 보급형에서도 20초 안쪽이에요. 아이디어 테스트할 때 이 차이가 생각보다 커요. 기다리다 지쳐서 포기하는 일이 줄어드니까.

증류 방식이 좀 다르다

큰 모델 지식을 작은 모델로 옮기면 보통 디테일이 뭉개져요. 색도 이상해지고. Z-Image는 품질 유지하는 부분이랑 학습 안정화하는 부분을 분리해서 처리했다고 해요. 그래서 압축했는데도 피부 질감 같은 게 살아있는 거예요.

뭘 만들 수 있나

포토리얼리즘 쪽이 강점이에요. 제품 사진, 인물 포트레이트, 광고 비주얼. 이런 거 만들 때 쓸만해요. 텍스트 렌더링도 잘 돼요. 영어, 중국어 둘 다 이미지 안에 깔끔하게 박혀요. 다른 모델들 글자 넣으면 삐뚤빼뚤한 거랑 비교하면 확실히 다름.

로컬에서 돌릴 수 있다

아파치 2.0 라이선스라 상업적으로 써도 돼요. 허깅페이스에서 모델 받을 수 있고, VRAM 16기가면 로컬에서 돌아가요. 4090이나 3090 있으면 직접 테스트해 볼 만함. 컴피UI 워크플로우도 돌아다니고 있어요.

단점도 있다

네거티브 프롬프트가 안 먹혀요. “이건 빼줘” 같은 지시가 안 된다는 건데, 증류 모델 특성이라고는 하는데 불편한 건 맞아요. 유화 느낌이나 애니 스타일도 기본 모델로는 약해요. 이쪽은 LoRA 따로 학습해야 돼요.

써볼 만한가

제품 이미지나 마케팅 비주얼 빨리 뽑아야 하는 상황이면 검토해 볼 만해요. 플럭스보다 진입장벽이 낮아요. 나온 지 한 달도 안 됐는데 벌써 LoRA 만드는 사람들 있으니까, 조금 더 지켜보면 활용 폭이 넓어질 것 같아요.